Forschungsprojekt SensorCloud

Das Forschungsprojekt SensorCloud beschäftigt sich im Rahmen des vom Bundeswirtschaftsministeriums (BMWi) geförderten Schwerpunktprojekts Trusted Cloud mit der Entwicklung von Technologien, die es erlauben, Sensordaten und Aktoren aus Cloud-Applikationen sicher zu erfassen, zu steuern und die Daten vieler Sensoren geeignet zu aggregieren.

Kooperationspartner sind die RWTH Aachen, die Telekommunikationsfirma QSC (Köln) und das Software-Unternehmen Symmedia (Bielefeld).

Die TH Köln hat im Rahmen des Gesamtkonsortiums die folgenden Teilaufgaben übernommen:

- Arbeitsbereich FDBS: Föderiertes Datenbanksystems für die SensorCloud (Prof. Dr. G. Büchel)

- Arbeitsbereich Testbett: Aufbau eines Testbetts für SensorCloud-Anwendungen (Prof. Dr. G. Hartung)

- Arbeitsbereich VisionSensor: Entwicklung eines VisionSensors für die SensorCloud (Prof. Dr. L. Thieling)

Auf einen Blick

| Kategorie | Beschreibung |

|---|---|

| Forschungsprojekt | Forschungsprojekt SensorCloud |

| Leitung | Prof. Dr. Gregor Büchel, Prof. Dr. Georg Hartung, Prof. Dr. Lothar Thieling |

| Fakultät | Fakultät für Informations-, Medien- und Elektrotechnik |

| Institut | Institut für Nachrichtentechnik |

| Beteiligte | M. Sc. Henning Budde, M. Sc. Thomas Partsch, Dr. Tobias Krawutschke |

| Projektpartner | RWTH Aachen, Fa. QSC AG (Köln), Fa. Symmedia (Bielefeld) |

| Fördermittelgeber | Bundesministerium für Wirtschaft und Energie (BMWi) - Forschungsprogramm "Trusted Cloud" |

| Laufzeit | 1.1.2012 – 31.12.2014; Nachfolgeprojekte sind in Vorbereitung. |

| Website |

Springe zu

(Bild: TH Köln)

(Bild: TH Köln)

Das projektierte System der SensorCloud wird einen komplexen Aufbau zur Erhebung, Verdichtung, Übermittlung und Steuerung von Sensordaten haben. Hardwareseitig wird die Cloud aus einem System hochleistungsfähiger vernetzter Rechner bestehen, die via Internet mit Gebäuden, in denen Sensordaten erhoben werden, verbunden sind. In diesem Verbund von Rechnern werden mannigfache Arten von Sensordaten im Interesse der Kunden und des Betreibers der SensorCloud persistent zu verwalten sein. Im Rahmen des Gesamtprojekts SensorCloud ist es Ziel dieses Teilantrags der FH Köln, ein Testbett als Prototyp eines Embedded System im Sinne der Projektskizze aufzubauen (s. Abbildung 1), über das Sensor-Cloud-Applikationen implementiert und evaluiert werden können. Zu diesem Testbett gehören Sensor-Aktornetzwerke unterschiedlicher Typen, bildverarbeitungsbasierte Sensorsysteme (VisionSensor) und lokale Rechner, die Verbindung zwischen lokalen Sensor-Aktornetzwerken in Gebäuden und der SensorCloud herstellen (Location Master). Das Testbett soll eine lokale Datenbank besitzen, die mit der globalen Datenbank der SensorCloud sicher kommuniziert.

Arbeitsbereich FDBS – Föderiertes Datenbanksystem für Sensor- und Aktordaten der SensorCloud

Erste Betrachtungen zum Aufbau eines geeigneten Persistenzmechanismus für die SensorCloud führen zum Problem der Integration heterogener Datenbankstrukturen in einem verteilten Datenbanksystem. Zur Lösung des Problems wird das Konzept föderierter Datenbanksysteme (FDBS) betrachtet und durch diverse Aktivitäten untersucht. Ein föderiertes Datenbanksystem ist ein schwach gekoppeltes verteiltes Datenbanksystem. Das Konzept föderierter Datenbanksysteme wird bei der Konstruktion von Data Warehouse Systemen angewandt. Ein FDBS kann als eine Vereinigung verschiedener Datenbanken, die jeweils ein eigenes lokales Schema haben, mit einem gemeinsamen globalen Schema angesehen werden.

(Bild: TH Köln)

(Bild: TH Köln)

Teststrecke

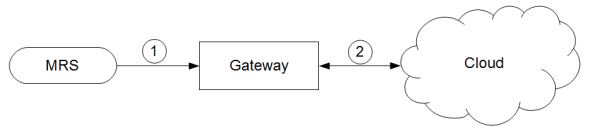

Dies ist eine vereinfachte grafische Übersicht der derzeit im Bereich FDBS untersuchten Teststrecke.

MRS: Multi-Raum-Sensor misst Temperatur, Luftfeuchtigkeit, Luftgüte und Bewegung.

(1): Sensordaten werden vom Sensor zum Gateway gesendet und in einer Datenbank abgelegt / gepuffert.

(2): Sensordaten aus dem Gateway werden mit der Cloud Datenbank synchronisiert.

Unter dem Aspekt der Verarbeitung von Sensor-/Aktor-Daten gemäß den Anforderungen einer TrustedCloud werden verschiendene Datenbankmanagementsysteme aus den Bereichen der relationalen, der objektorientierten und der NoSQL Datenbanken untersucht.

Aktivitäten

- Anforderungsanalyse

- Deploymentanalyse

- Semantische Analyse mittels Ontologien

- Spezifikation und Implementierung des konzeptionellen Schemas des FDBS zur Verwaltung der Sensordaten

- Schema Monitoring

- Transaktionen

- Zwischenspeicherung von Sensordaten bei fehlender Internetverbindung

- DB Dienste zur Unterstützung von Sensordaten

- DB Dienste zur Unterstützung des Location Master als Trustpoint

- DB Lasttest

- DB Systemintegration auf dem Location Master und in der Cloud

- Gesamttest des FDBS für Sensordaten

- Gesamtdokumentation des FDBS im Projekt SensorCloud

LEGO-Roboter

Als ein Anwendungsfall des Ansteuerns eines Aktors aus dem FDBS der SensorCloud wurde zu Demonstrationszwecken ein einfacher LEGO-Roboter mit Greifarm entwickelt, dessen Fahrbefehle und dessen Greifarmsteuerung über ein Android Smartphone eingegeben bzw. gesteuert werden können, das Client der SensorCloud ist.

Die Fahrbefehle und Befehle zur Greifarmsteuerung werden als Tasklisten (Aktoranforderungen) im FDBS der SensorCloud gespeichert.

Arbeitsbereich Testbett

Das zentrale Hardware Element der Entwicklungen ist der Location Master, der zwischen SensorCloud und Sensoren vermittelt. Das Testbett stellt eine Sensor/Aktor- Umgebung für den Location Master dar.

Der Location Master wird als eingebetteter Linux-Rechner aufgebaut, der mit Netzwerk-Schnittstellen zu Sensor/Aktornetzwerken einerseits und einem WLAN andererseits ausgerüstet wird. Das erste Arbeitspaket dazu umfasst vor allem die Auswahl und Beschaffung, Inbetriebnahme, Aufbau der Software-Entwicklungsumgebung und die Erweiterung mit Schnittstellen zu den Sensor/Aktornetzwerken.

Darauf aufbauend steht die Entwicklung der Hardware Schnittstellen von RS232 bis Zigbee und entsprechender Treiberentwicklung an.

Ein Sensorprototyp, der in einen integrierten Multiraumsensor überführt wird, ist der erste im Testbett verfügbare Sensor, ein weiterer zu entwickelnder Sensor ist ein Stromsensor zur dezentralen Erfassung des Energieverbrauchs. Um die Sensorpalette des Testbetts zu erweitern wird eine bestehendes Heimautomatisierungsnetzwerk in die SensorCloud integriert.

Das plattformunabhängige DOG-System, dass an der Universität Turin entwickelt wurde, wird auf den Location Master portiert. Parallel wird die wissensbasierte Beschreibung der eigenen und angepassten Sensoren bzw. Aktoren erstellt. Die sichere Kommunikation zur SensorCloud wird durch Einrichtung eines Trustpoints gewährleistet.

Die Testbettgruppe stellt die Integration der vom Konsortialpartner entwickelten Dienste in den Location Master sicher.

Aktivitäten

TB Hardware Entwicklung: Entwicklung der Gateway Hardware

TB Location Master: Location Master Entwicklung

TB Multiraumsensor: Multi Raum Sensor Entwicklung

Arbeitsbereich Vision Sensor

Vision-Systeme kommen heute vornehmlich im industriellen Umfeld im Rahmen der Automatisierungstechnik zum Einsatz. In Verbindung mit einer homogenen und einfachen internetbasierten Kommunikation, Speicherung und Verarbeitung der Sensordaten mittels SensorClouds ergeben sich neue Einsatzmöglichkeiten für Vision-Systeme, auch außerhalb von Werkshallen und besonders auch im verbrauchernahen Bereich, wie z.B.

- sicherheitstechnische Gebäude- bzw. Raumüberwachung,

- Ermittlung der Auslastung öffentlicher Nahverkehrsmittel,

- Home-Monitoring pflegebedürftiger Personen.

Diese Auflistung lässt sich noch nahezu beliebig weiter führen. Bei all diesen Anwendungen werden die VisionSensoren in großen Stückzahlen benötigt und im alltäglichen Umfeld eingesetzt. Hieraus ergeben sich die speziellen Anforderungen hinsichtlich geringer Kosten, Größe, Strombedarf sowie hoher Kommunikationsfähigkeit.

Der Arbeitsbereich beschäftigt sich daher mit der Konzeption und Entwicklung eines modularen Vision-Systems, das durch Kombination und Konfiguration hinsichtlich der verschiedenen Anforderungsprofile skalierbar ist. Die wesentlichen konzeptionellen Grundlagen sind hierbei wie folgt:

- Bildvorverarbeitung mittels FPGAs (Field Programmable Gate Arrays): FPGAs sind für die Implementierung einfacher aber schneller Abläufe prädestiniert. Bildvorverarbeitungsalgorithmen (z.B. FIR-Filter) sind wenig komplex, müssen aber auf der großen Menge der Bilddaten ausgeführt werden. Sie können daher optimal auf einem FPGA implementiert werden. Die Spezifikation der Algorithmen geschieht hardwareunabhängig in VHDL (Very High Speed Integrated Circuit Hardware Description Language) wodurch sich wieder verwendbare Modul-Bibliotheken für die schnelle Bildvorverarbeitung implementieren lassen.

- Bildauswertung mittels Prozessoren der ARM-Technologie: Die Implementierung komplexer Algorithmen (z.B. zur Klassifikation) muss auf Prozessoren erfolgen. Hier hat sich mit der ARM-Technologie in den letzten Jahren ein Quasi-Standard für Prozessoren etabliert, der eine Skalierbarkeit der Rechenleistung bei größtmöglicher Kompatibilität garantiert. Hierzu stehen u.a. sogenannte Soft-Cores (in VHDL spezifizierte Prozessoren) zur Verfügung, die auch auf einem FPGA implementiert werden können.

- Konzeptionelle Verankerung von Komponenten aus dem Consumer-Bereich: Vision- und Kommunikationskomponenten (Kamera, WLAN, Ethernet, ZigBee) sind heute in Massenprodukte (z.B. SmartPhones, WebCams, Funkthermometern) enthalten. Solche Komponenten sind preiswert, klein und Strom sparend.