Infrastruktur

Hier finden Sie die Infrastruktur aus allen Bereichen

AR/VR/XR

Cyberith Virtualizer in der Anwendung

(Bild: Cyberith Virtualizer)

Cyberith Virtualizer in der Anwendung

(Bild: Cyberith Virtualizer)

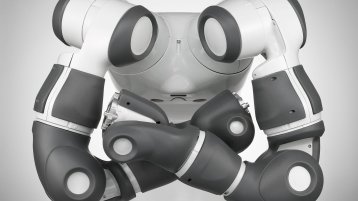

Cyberith Virtualizer

Der Virtualizer von Cyberith ist eine voll-immersive Plattform zur Bewegungssimulation von Virtual-Reality Anwendungen. Mit Hilfe hochpräziser Sensoren können Bewegungen, Geschwindigkeiten und Drehrichtungen des Nutzers erfasst und auf eine VR-Umgebung übertragen werden. So lassen sich in virtuellen Welten Bewegungen wie u.a. Laufen, Springen oder Hocken umsetzen und diese Welten auf eine neue Weise erkunden. Der Virtualizer kann mit der Oculus Quest 2 eingesetzt werden, um das immersive Erleben noch realer zu gestalten.

Im Einsatz: FutureING AR-Spiel

Anwendungsbereiche: AR/VR/XR-Entwicklung

Ansprechpartner*in: Prof. Dr. Anja Richert, Tobias Keller

Desktop AR-Anwendung

(Bild: Fakultät für Anlagen, Energie- und Maschinensysteme/THKöln)

Desktop AR-Anwendung

(Bild: Fakultät für Anlagen, Energie- und Maschinensysteme/THKöln)

Desktop AR-Anwendungen

Desktop AR (Augmented Reality) Anwendungen erweitern die Realitätswahrnehmung um 3D Objekte oder Informationen, die durch ein Smartphone oder Tablet in der Umgebung sichtbar gemacht werden. Der Nutzen und die Anwendung von AR-Applikationen werden aktuell für konkrete ingenieurwissenschaftliche Lehrszenarien (u.a. für das Modul Werkstoffanwendung) in diversen Masterarbeiten genauer erforscht. Ein weiteres Beispiel ist die Anwendung „AR Mechanics“ im Modul „Traktortechnik“ von Prof. Meinel. Die App für Smartphone und Tablet macht die Funktionsweise eines Hinterachsdifferentialgetriebes real erlebbar und ermöglicht Studierenden, durch Erweiterung der räumlich-visuellen Wahrnehmung des Objektes, die Visualisierung abstrakter theoretischer Prozesse sowie die virtuelle Interaktion mit dem Getriebe.

Anwendungsbereiche: AR/XR-Entwicklung

Ansprechpartner*in: Prof. Dr. Anja Richert

HoloLens2 Remote Assist

(Bild: Microsoft)

HoloLens2 Remote Assist

(Bild: Microsoft)

icrosoft HoloLens 2 (AR Brille)

Die Microsoft HoloLens ist eine AR-Brille, die dem Benutzer erlaubt, mit der Unterstützung durch ein Natural User Interface interaktive 3D-Projektionen in der direkten Umgebung darzustellen. Die Microsoft HoloLens ist über Gesten, Sprache, Kopfbewegung und kleine Knöpfe zu bedienen. Über Kameras ist es möglich die Umgebung, Bewegungen und Gesten wahrzunehmen. Im Master-Modul X-Realities des Studiengangs Maschinenbau wird die Wirklichkeit mit der HoloLens 2 virtuell erweitert. Es werden 3D Objekte/Hologramme in den Raum projiziert und digitale Informationsebenen oder visuelle Hilfestellungen in die reale Welt integrieren. 3D-Projektionen und immersive Anwendungen für die ingenieurwissenschaftliche Lehre mit der HoloLens 2 werden außerdem zurzeit in einer Masterarbeit näher untersucht.

Anwendungsbereiche: AR/XR-Entwicklung

Ansprechpartner: Prof. Dr. Anja Richert, Dr. Valérie Varney,Tobias Keller

HTC VIVE

(Bild: Fakultät für Anlagen, Energie- und Maschinensysteme/THKöln)

HTC VIVE

(Bild: Fakultät für Anlagen, Energie- und Maschinensysteme/THKöln)

HTC Vive Pro (VR-Brille)

Das HTC Vive Pro ist ein Virtual-Reality Set mit dem Erleben und Arbeiten in der virtuellen Welt ermöglicht werden. Besonders hervorzuheben ist die Auflösung von 2880x1600 Pixel der VR-Brille. Mit dem VR-Set können mehrere Menschen auf einer Fläche bis zu 100m² miteinander virtuell interagieren. Des Weiteren ist die HTC Vive Pro ebenfalls im Cyberith Virtualizer einsetzbar.

Anwendungsbereiche: VR/XR-Entwicklung

Ansprechpartner*in: Prof. Dr. Anja Richert, Dr. Valérie Varney, Tobias Keller, Paul Varney

Oculus Quest 2 im Mixed-Reality Game FutureING

(Bild: Cologne Cobots Lab/TH Köln)

Oculus Quest 2 im Mixed-Reality Game FutureING

(Bild: Cologne Cobots Lab/TH Köln)

Oculus Quest 2 (VR Brille)

VR (Virtual Reality) Brillen erlauben es dem Benutzer in eine digitale Welt einzutauchen. Dies kann man sich beispielsweise in VR-basierten Trainings zunutze machen, die durch Learning by doing zu einem tieferen Verständnis führen können. Die Oculus Quest 2 ermöglicht im Maschinenbau Master-Modul X-Realities immersives Arbeiten. Auch in Game basierten Lernsetting ist der Einsatz möglich: Das Mixed-Reality Game FutureING, das Bestandteil des Bachelor-Moduls "Arbeitstechniken und Projektorganisation ist, wird aktuell um die Anwendung mit der VR-Brille erweitert.

Im Einsatz: FutureING AR-Spiel

Anwendungsbereiche: AR/VR/XR-Entwicklung

Ansprechpartner*in: Prof. Dr. Anja Richert, Dr. Valérie Varney, Tobias Keller,Paul Varney

Entwicklungsumgebungen

(Bild: Pexels)

(Bild: Pexels)

Im Labor wird in und mit verschiedenen Entwicklungsumgebungen gearbeitet und programmiert. Die folgende Liste gibt Aufschluss mit welchen Betriebssystemen das Labor arbeitet und für welchen Bereich die einzelnen Systeme eingesetzt werden.

Desktop-PC‘s

- Plattform: Linux & Windows

- Anwendungsbereiche: AR/VR/XR-Entwicklung, CAD, Künstliche Intelligenz, Programmierung, Sensorik, Simulation & Berechnung

Laptop‘s

- Plattform: Linux, Mac & Windows

- Anwendungsbereiche: Mobiles Arbeiten, Programmierung, Sensorik, Studiendurchführungen

Tablet’s

- Plattform: Mac

- Anwendungsbereiche: Mobiles Arbeiten, Studiendurchführungen

Raspberry Pi 3B+ & 4

- Plattform: Linux, Octoprint, Raspbian

- Anwendungsbereiche: additive Fertigung, Programmierung, Sensorik

Sensorik

(Bild: Denis Cosmin)

(Bild: Denis Cosmin)

3D-Lidar RoboSense RS-LiDAR-16

- Funktion: Dreidimensionale Abstandsmessung mittels Laser

- Anwendungsbereiche: Kartierung, Navigation, Simultaneous Localization and Mapping (SLAM)

- Forschungsprojekte: Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert

EDA-Sensor

- Funktion: Messung des Hautleitwerts

- Anwendungsbereiche: Vitaldaten, Stressreaktion, körperliche/mentale Beanspruchung

- Forschungsprojekte: MeRobot, MyRobot, Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert, Caterina Neef

EEG-Sensor

- Funktion: Messung der Hirnaktivität

- Anwendungsbereiche: Vitaldaten, Stressreaktion, körperliche/mentale Beanspruchung

- Forschungsprojekte: Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert, Caterina Neef

EKG-Sensor

- Funktion: Messung der Herzaktivität

- Anwendungsbereiche: Vitaldaten, Stressreaktion, körperliche/mentale Beanspruchung

- Forschungsprojekte: MeRobot, MyRobot, Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert, Caterina Neef

EMG-Sensor

- Funktion: Messung der Muskelanspannung

- Anwendungsbereiche: Vitaldaten, Stressreaktion, körperliche/mentale Beanspruchung

- Forschungsprojekte: Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert, Caterina Neef

Lux-Sensor

- Funktion: Messung der Helligkeit

- Anwendungsbereiche: Versuchsumgebungen

- Forschungsprojekte: Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert, Caterina Neef

Microsoft Azure Kinect DK

- Funktion: Bildverarbeitung mittels dreidimensionaler Kameras

- Anwendungsbereiche: Bodytracking, Bewegungsanalyse

- Forschungsprojekte: Milki-PSY, Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert, Tobias Keller, Nicolas Kaulen

PupilLabs Pupil Core

- Funktion: Eyetracking mittels zweidimensionaler Kameras

- Anwendungsbereiche: Vitaldaten, Stressreaktion, körperliche/mentale Beanspruchung

- Forschungsprojekte: MeRobot, Master & Studienarbeiten

- Ansprechpartner*in: Prof. Dr. Anja Richert

Roboter | Drohnen

DJI Mavic Mini Drohne

(Bild: DJI.com)

DJI Mavic Mini Drohne

(Bild: DJI.com)

DJI Mavic Mini

Kleine Drohne mit einem Gesamtgewicht von unter 250 Gramm. Durch die Ausstattung einer 4K Kamera und einer Flughöhe von maximal 3.000 Meter, lassen sich spektakuläre Videoaufnahmen erzeugen.

Technische Informationen:

- Gewicht: 249 g

- Dimension:

- Gefaltet: 140 × 81 × 57 mm (L×B×H)

- Ausgefaltet: 159 × 202 × 55 mm (L×B×H)

- Ausgefaltet (mit Propellern): 245 × 289 × 55 mm (L×B×H)

- Geschwindigkeiten:

- Max. Steiggeschwindigkeit: 4 m/s

- Max. Sinkgeschwindigkeit: 3 m/s

- Max. Fluggeschwindigkeit: 13 m/s

- Max. Flughöhe: 3.000 m

- Maximale Reichweite: 580 mm

- Max. Flugzeit: ~ 30 Minuten

- Schwebefluggenauigkeit: +/- 0,1 m (vertikal); +/- 0,3 m (horizontal)

- Kamera:

- Max. Auflösung: 4000x3000 (4:3); 4000x2250 (16:9)

- Video: 2,7K (30 fps); FHD (60 fps)

Anwendungsbereiche: Virtuelle Laborbegehung, Filmaufnahmen

Ansprechpartner*in: Prof. Dr. Anja Richert

ABB IRB120

Kleiner Industrieroboter mit geringem Gewicht zum vielfältigen und flexiblen Einsatz. Der Roboter eignet sich besonders für schnelle und präzise Handhabungsaufgaben und geringem Platzangebot.

Technische Informationen:

- Gewicht: 25 kg

- Wiederholgenauigkeit: +/- 0,01 mm

- Nutzlast: 3 kg

- Freiheitsgrade: 6

- Maximale Reichweite: 580 mm

- Schnittstelle: Ethernet (TCP/IP)

Anwendungsbereiche: Industrieroboter, Pick&Place

Ansprechpartner*in: Prof. Dr. Ulf Müller, Prof. Dr. Anja Richer

ABB IRB140

Industrieroboter mit hoher Leistungsfähigkeit und Flexibilität bezogen auf Montageaufgaben. Die Kollisionserkennung mit Freifahrbewegung bietet dem Anwender ein hohes Maß an Sicherheit.

Technische Informationen:

- Gewicht: 98 kg

- Wiederholgenauigkeit: +/- 0,03 mm

- Nutzlast: 6 kg

- Freiheitsgrade: 5

- Maximale Reichweite: 810 mm

- Schnittstelle: Ethernet (TCP/IP)

Anwendungsbereiche: Industrieroboter, Pick&Place

Forschungsprojekte: Mehrachsiger 3D Druck, Master & Studienarbeiten

Ansprechpartner*in: Prof. Dr. Ulf Müller, Prof. Dr. Anja Richert

Furhat Robotics

(Bild: Furhat Robotics)

Furhat Robotics

(Bild: Furhat Robotics)

Furhat

Furhat ist ein sozialer Roboter, welcher für Natural Language Processing entwickelt wurde. Er spricht, hört zu, besitzt ein breites Band an Emotionen und Mimiken und kann ebenso Augenkontakt halten. Das System unterstützt mehrere Spracherkennungssysteme mit mehr als 40 Sprachen und eine der weltweit größten Sammlungen von synthetisierten Stimmen. Furhat verfügt über eine Reihe leistungsstarker Werkzeuge. So lassen sich schnell neue Gesichter und Gesten sowie Augen- und Kopfbewegungen für Furhat erstellen und implementieren. Weiterhin kann das System expressive Bewegungen von Benutzer:innen einzufangen und entsprechend mit Gestiken und Mimiken sowie einer Stimmveränderung reagieren.

Technische Daten:

- Dimension: 410 x 270 x 240 mm (HxBxT)

- Gewicht: 3,5 kg

- Freiheitsgrade: 3

- Spracherkennung und Dialogfunktion (> 40 Sprachen; > 120 Varianten)

- Gestik/Mimik: 19 Expressionen

- Sensorik: RGB-Kamera, Onboard Microphon (2x), USB Mikrophon (4x), RFID,

- Schnittstelle: Ethernet (TCP/IP), Wi-Fi IEEE 802.11 a/c, Bluetooth 4.2, USB

Anwendungsbereiche: Forschen, Business-to-Consumer

Forschungsprojekte: SKILLED, Master & Studienarbeiten

Ansprechpartner*in:Prof. Dr. Anja Richert, Ana Müller, Michael Schiffmann

Igus Robolink D

(Bild: F09/TH Köln)

Igus Robolink D

(Bild: F09/TH Köln)

Igus Robolink D

Drehachse mit integriertem Motor zum Verbauen in Industrierobotern. Die Drehachse ist mit vielen Schrittmotoren kompatibel und die selbsthemmenden Antriebe bieten ein hohes Maß an Sicherheit

Technische Informationen:

- Dimension: 360 x 160 mm

- Gewicht: 21,4 kg

- Wiederholgenauigkeit: +/- 1 mm

- Nutzlast: 500 g

- Freiheitsgrade: 5

- Maximale Reichweite: 680 mm

- Schnittstelle: Ethernet (TCP/IP)

Anwendungsbereiche: Industrieroboter, Pick&Place

Forschungsprojekte: Master & Studienarbeiten

Nao: Humanoider, sozialer Roboter

(Bild: doc.aldebaran.com)

Nao: Humanoider, sozialer Roboter

(Bild: doc.aldebaran.com)

Nao: Humanoider, sozialer Roboter

NAO ist ein humanoider, sozialer Roboter der Firma Softbank Robotics. Konzipiert für die Mensch-Maschine-Interaktion, erkennt er mittels seiner Sensorik Gesichter, Objekte und einfache menschliche Emotionen. Zudem kann er Gehen, Tanzen und sich mit seinem Gegenüber in bis zu 21 Sprachen unterhalten.

Technische Daten:

- Dimension: 574 x 275 x 311 mm (HxBxT)

- Gewicht: 5,4 kg

- Freiheitsgrade: 25

- Spracherkennung und Dialogfunktion (bis zu 21 Sprachen)

- Sensorik: 2D-Kamera (2x), 3-Achsen-Beschleunigungssensor, 3-Achsen-Gyrometer, Force Sensing Resistor (8x), Hall-Sensor (36x), Mikrophon (2x), Sonar (4x), Touch-Sensor (9x)

- Schnittstelle: Ethernet (TCP/IP), Wi-Fi IEEE 802.11 a/b/g/n, USB

Anwendungsbereiche: Lernen, Forschung, Gesundheitswesen

Forschungsprojekte: Master & Studienarbeiten

Ansprechpartner*in: Prof. Dr. Chunrong Yuan, Prof. Dr. Anja Richert

Humanioder Roboter Pepper

(Bild: Michael Bause/TH Köln)

Humanioder Roboter Pepper

(Bild: Michael Bause/TH Köln)

Pepper: Humanoider, sozialer Roboter

Pepper ist ein humanoider, sozialer Roboter. Der Roboter kann Gesichter und einfache menschliche Emotionen erkennen. Man kann mit ihm Unterhaltungen führen sowie durch den vorderseitig montierten Touchscreen kommunizieren.

Technische Daten:

- Dimension: 1208.5 x 477.2 x 424 (HxBxT)

- Gewicht: 29,1 kg

- Freiheitsgrade: 20

- Spracherkennung und Dialogfunktion (bis zu 15 Sprachen)

- Sensorik: 2D Kamera (4x), 3D Kamera, 3-Achsen-Beschleunuigungssensor, 3-Achsen Gyrometer, Infrarot-Sensor (2x), Hall-Sensor (27x), Laserabstandssensoren (9x), Mikrophon (4x), Sonar (2x), Touch-Sensor (5x)

- Schnittstelle: Ethernet (TCP/IP), WiFi (802.11a/b/g/n)

Anwendungsbereiche: Lernen, Forschung: Business-to-Business, Business-to-Consumer

Forschungsprojekte: SKILLED, GeneRobot, Master & Studienarbeiten

Ansprechpartner*in: Prof. Dr. Anja Richert, Caterina Neef, Ana Müller

Panda

(Bild: Franka Emika)

Panda

(Bild: Franka Emika)

Panda: Kollaborativer Leichtbauroboter

Panda ist der kollaborative Leichtbauroboter der Franka Emika GmbH. Das Modell besitzt 7 Achsen, die alle mit Kraft-Momenten-Sensoren ausgestattet sind. Das Robotersystem kann über eine browserbasierte Benutzeroberfläche programmiert werden.

Technische Daten:

- Gewicht: ~ 18 kg

- Wiederholgenauigkeit: +/- 0.1 mm

- Nutzlast: 3 kg

- Freiheitsgrade: 7

- Greifer: Parallel

- Max. Reichweite: 855 mm

- Schnittstelle: Ethernet (TCP/IP)

Anwendungsbereiche: Produktion, kollaborative Montage

Forschungsprojekte: QuKu-ML, Master & Studienarbeiten

Ansprechpartner*in: Prof. Dr. Anja Richert, Nicolas Kaulen

Roboterarm Schunk LWA 4D

(Bild: Schunk)

Roboterarm Schunk LWA 4D

(Bild: Schunk)

Schunk LWA 4D

Der Leichtbauroboterarm 4D kann mit den Schunk Greifsystemen kombiniert werden. Die hohe Traglast von 10 kg ermöglicht einen Einsatz bei Pick-and-Place Anwendungen.

Technische Informationen

- Gewicht: 18 kg

- Wiederholgenauigkeit: +/- 0,15 mm

- Nutzlast: 10 kg

- Freiheitsgrade: 7

- Maximale Reichweite: 1113,4 mm

- Schnittstelle: CANopen (CiA DS402:IEC61800-7-201)

Anwendungsbereiche: Industrieroboter, Pick&Place

Forschungsprojekte: Master & Studienarbeiten

Ansprechpartner*in: Prof. Dr. Anja Richert

TIAGo

(Bild: Pal robotics)

TIAGo

(Bild: Pal robotics)

TIAGo (Steel): Mobiler Manipulator

TIAGo ist ein mobiler Manipulator der spanischen Firma PAL Robotics. Das im CobotsLab vorhandene Modell besitzt einen Arm, der mit einem Parallelgreifer ausgestattet ist. Damit sind Pick & Place Operationen möglich. Mit Sensoren zur Pfadplanung und Kollisionsvermeidung eignet sich TIAGo zur Navigation. Die mehrsprachige Sprach- und Text-zu-Sprache-Erkennung erlaubt den direkten Austausch mit Menschen. Weiterhin kann das Robotersystem Objekte, Gesichter und Positionen erkennen.

Technische Daten:

- Höhe: 1100 bis 1450 mm

- Gewicht: 70 kg

- Fußfläche : ø 540 mm

- Freiheitsgrade: 12

- Nutzlast ohne Greifer: 3 kg

- Reichweite (ohne Endeffektor): 870 mm

- Sensorik: Laser, inertiale Messeinheiten, RGB-D Kamera

- Schnittstellen WiFi 802.11 n/ac, Bluetooth 4.0

Anwendungsbereich: Forschung

Forschungsprojekte: Master & Studienarbeiten

Ansprechpartner*in: Prof. Dr. Anja Richert

YuMi

(Bild: new.abb.com)

YuMi

(Bild: new.abb.com)

YuMi IRB 14000: Industrieller, kollaborativer Roboter

YuMi ist der kollaborative Zweiarm-Roboter der Firma ABB. Aufgrund seines Design- und Sicherheitskonzepts ist er weltweit der erste kollaborative Zweiarm-Roboter, der für die Kleinteilmontage entwickelt wurde. Das Modell besitzt zwei Arme mit je sieben Achsen. Hervorzuheben ist hierbei seine Wiederholgenauigkeit von 0,02 mm. Der YuMi wird über die Programmier- und Simulationssoftware RobotStudio programmiert. Der YuMi ist Gegenstand im Master Modul Mensch-Maschine-Interaktion. Hier werden Inhalte für das kollaborative Arbeiten mit dem Roboter programmiert.

Technische Daten:

- Maximaler Arbeitsraum: 1018 x 1328 x 1086 mm

- (HxBxT)

- Gewicht: 38 kg

- Wiederholgenauigkeit: +/- 0,01 mm

- Handhabungskapazität: 500 g

- Freiheitsgrade: 14

- Schnittstelle: Ethernet (TCP/IP

- Sicherheitsnorm: EN ISO 10218-1:2011

Forschungsprojekte: MeRobot, MyRobot, Milki-PSY, Master & Studienarbeiten

Ansprechpartner*in: Prof. Dr. Anja Richert, Tobias Keller

Additive & Werkzeuge

Prusa i3 MK3s 3-Drucker

(Bild: Prusa)

Prusa i3 MK3s 3-Drucker

(Bild: Prusa)

Additive Fertigung (3D-Drucker)

3D-Drucker zum Rapid Prototyping. Durch die Verwendung von CAD-Daten können mit den Druckern in kurzer Zeit Prototypen und Werkstücke für Konstruktions- und Forschungsprojekte hergestellt werden.

- Prusa i3 MK3S

- Ultimaker 2+ & 3

- Verwendbare Materialien: PLA, PETG, ASA, ABS, PC (Polycarbonat), CPE, PVA/BVOH, PVB, HIPS, PP (Polypropylen), Flex, nGen, Nylon, Carbon gefüllt, Woodfill und andere gefüllte Materialien

Ansprechpartner*in: Prof. Dr. Anja Richert, Dario Luipers

(Bild: blickpixel)

(Bild: blickpixel)

Werkzeuge

- Handarbeitsplätze (Drehen, Fräsen, Bohren), CNC-Fräsmaschine

- Lötarbeitsplätze, SPS-Steuerungen, Zugriff auf Zentralwerkstatt der Elektrotechnik

- Zugriff auf Zentralwerkstatt des Maschinenbaus

Ansprechpartner*in: Prof. Dr. Anja Richert, Prof. Dr. Ulf Müller